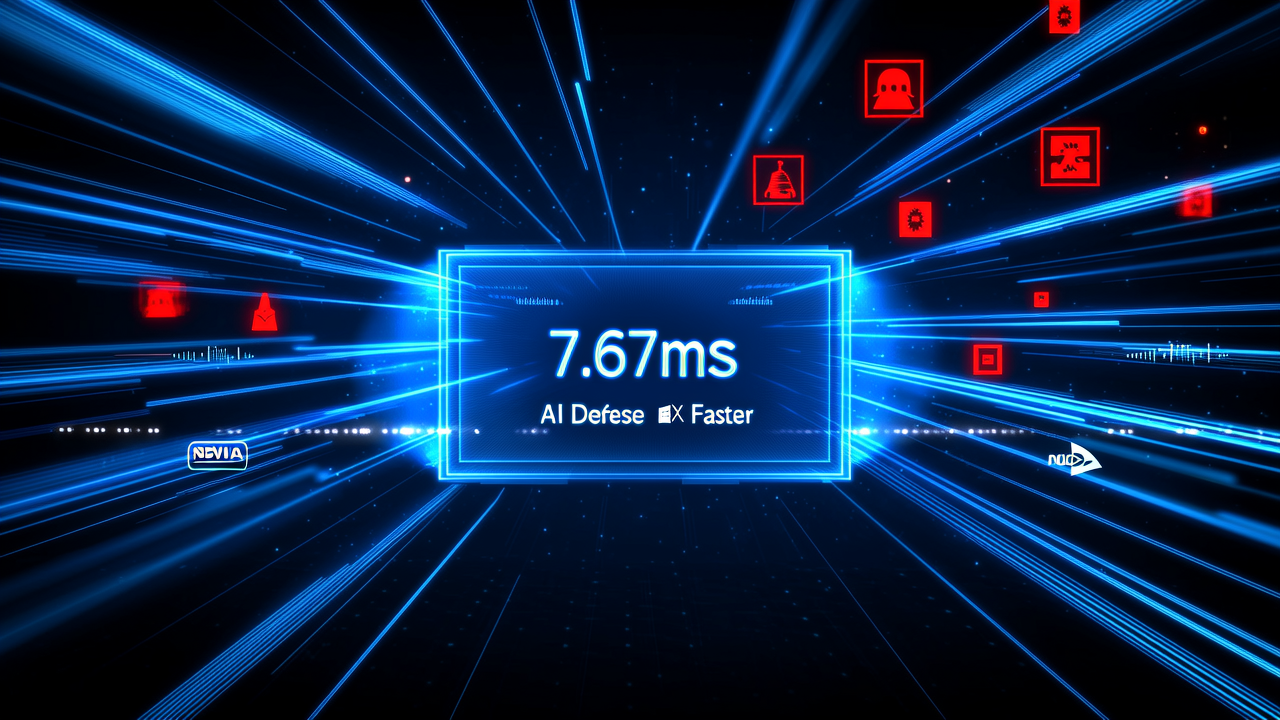

AI防御系统竟能160倍提速?微软英伟达联手突破算力瓶颈,7.67毫秒实时拦截黑客攻击!这场震撼技术革命能否终结AI安全危机?

相比静态防御机制,具备实时对抗学习能力的AI安全系统正展现出决定性优势。随着攻击者开始运用强化学习和大型语言模型技术,“氛围黑客”等自适应威胁的变异速度已超越人工响应极限,仅靠政策无法化解这一治理危机。

攻击者现采用多步推理与自动代码生成技术突破传统防线,行业正被迫向“自主防御系统”转型。然而部署基于Transformer架构的实时防御始终面临算力瓶颈——微软NEXT.ai首席应用研究经理Abe Starosta指出:“唯有同步实现低延迟、高吞吐与高精度,对抗学习才能投入实战。”

【性能突破】微软与英伟达的联合工程方案通过硬件加速与内核级优化打破困局:

– CPU基准测试显示单请求延迟高达1239毫秒,吞吐量仅0.81次/秒

– 采用H100 GPU集群后延迟骤降至17.8毫秒

– 经推理引擎与分词系统深度优化,最终实现7.67毫秒超低延迟(性能提升160倍)

项目过程中暴露的关键洞察:数据预处理环节中的分词机制竟成隐形瓶颈。通用分词技术针对自然语言设计,面对缺乏自然分隔的机器生成数据时效能骤降。工程团队为此开发了安全专用分词器,通过定制化分段策略使分词延迟降低3.5倍。

技术架构整合了英伟达Dynamo推理服务器与TensorRT加速的威胁分类器,通过将归一化、嵌入层等操作融合为定制CUDA内核,前向传播延迟从9.45毫秒压缩至3.39毫秒。英伟达网络安全经理Rachel Allen强调:“防御系统必须同时具备超低延迟与持续进化能力,对抗学习与TensorRT的结合正实现这一目标。”

延伸思考

1. 当攻击AI与防御AI进入持续对抗的循环演进,是否会催生超出人类理解范畴的攻防策略?

2. 在金融、医疗等强监管领域,自主防御系统的误判责任将如何界定?

【趋势研判】随着威胁主体实时操纵AI变异攻击,企业需构建具备充足算力余量的基础设施。依赖CPU进行高级威胁检测正在演变为系统性风险,正如图形渲染转向GPU,实时安全推理需要专业硬件支撑>130次/秒的吞吐能力。未来安全架构将聚焦对抗性鲁棒训练,结合量化技术持续优化,构建与时俱进的实时AI防护基石。

阅读 ArtificialIntelligence News 的原文,点击链接。