算法公平神话破灭?阿姆斯特丹福利AI竟暗藏偏见,MIT专家揭露震撼真相!技术真能实现绝对公平吗?

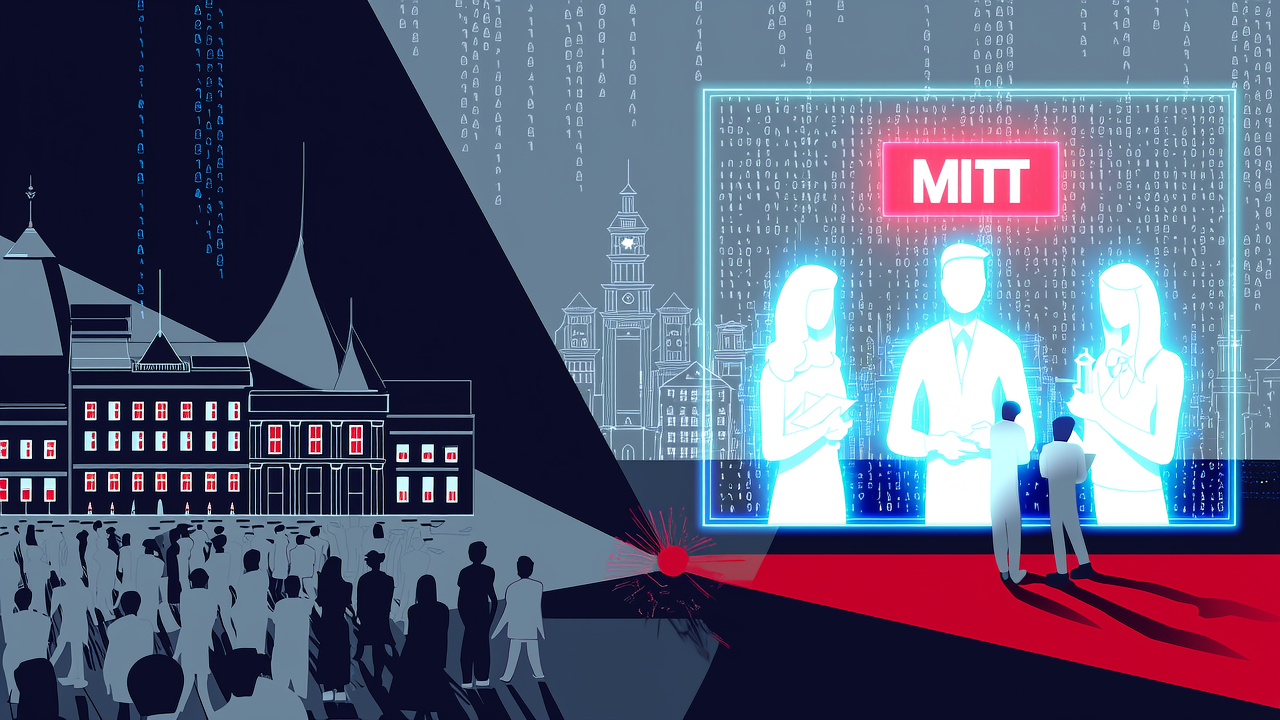

【算法公平性之辩】MIT独家对话:阿姆斯特丹福利算法为何失败?

一场仅限MIT校友及订阅者专享的深度讨论:当荷兰阿姆斯特丹市政府试图用算法公平评估福利申请人时,系统性偏见仍悄然渗入。这背后暴露了哪些技术伦理困境?更重要的是——算法真的能实现绝对公平吗?

MIT Technology Review调查编辑阿曼达·西尔弗曼、调查记者郭艾琳(Eileen Guo)与灯塔报告组织调查记者加布里埃尔·盖格将带来前沿案例分析。

主讲人阵容:

– 郭艾琳 | 深度调查记者

– 阿曼达·西尔弗曼 | MIT科技评论调查编辑

– 加布里埃尔·盖格 | 灯塔报告组织调查记者

对话时间:2025年7月30日

延伸思考:

1. 当算法决策涉及社会福利分配时,技术中立性神话是否已被彻底打破?

2. 【警示案例】阿姆斯特丹的失败会如何影响全球政府数字化转型进程?

(本文为节选,完整内容需订阅查看)

阅读 Technology Review 的原文,点击链接。