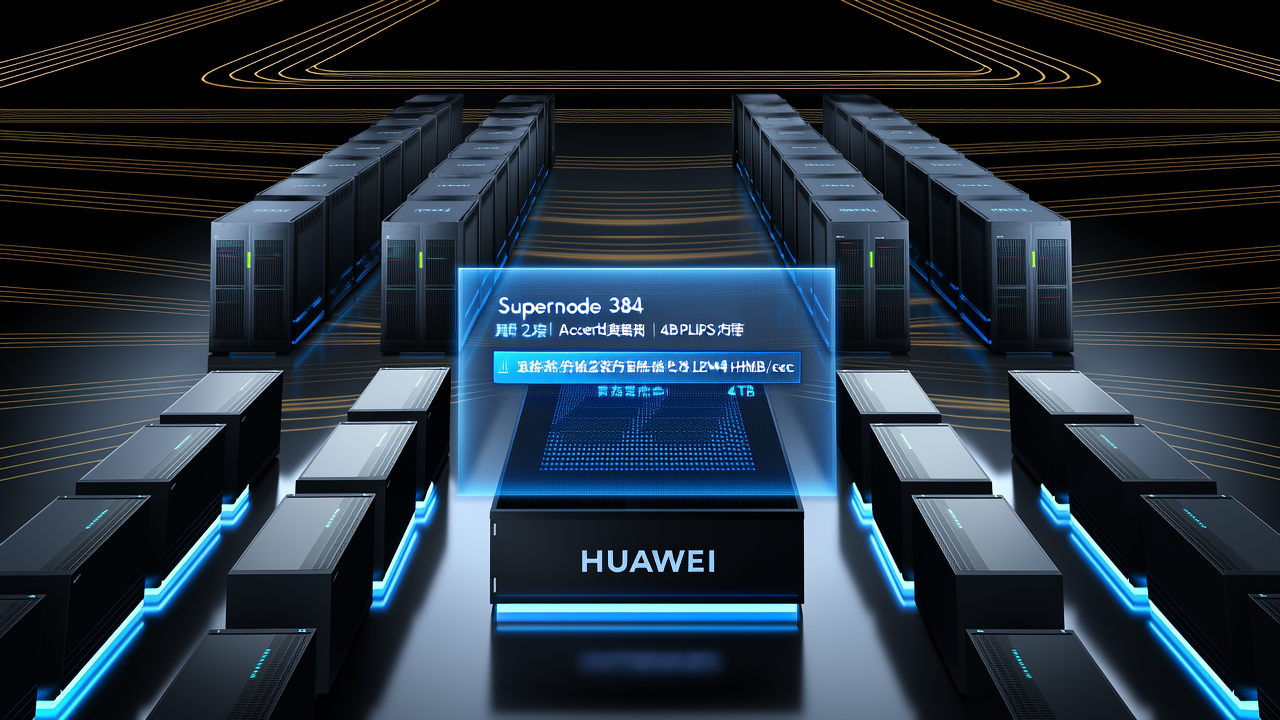

华为AI芯片性能碾压英伟达?Supernode 384震撼发布,算力暴涨2.5倍,中美科技战迎来关键转折点!

华为AI技术实现重大突破!其最新发布的Supernode 384架构在全球处理器竞争中写下关键一笔,这在中美科技博弈背景下尤具战略意义。【重磅】这项创新成果于上周五在深圳举行的”鲲鹏昇腾开发者大会”上亮相,直接挑战英伟达长期的市场垄断地位——尽管华为仍面临美国主导的严厉贸易限制。

昇腾计算业务总裁张迪煊在主题演讲中揭示了技术突破的核心动因:”随着并行处理规模扩大,传统服务器架构的跨机带宽已成为AI训练的致命瓶颈。”Supernode 384彻底摒弃冯·诺依曼计算体系,采用专为现代AI工作负载设计的点对点架构,特别适合混合专家模型(通过多个专业子网络解决复杂计算任务的机器学习系统)。

技术参数令人瞩目【性能飞跃】:

– 384颗昇腾AI处理器

– 12个计算柜+4个总线柜

– 300千万亿次/秒算力

– 48TB高带宽内存

实测数据显示,该系统运行Meta的LLaMA 3模型时单卡速度达132 token/秒,性能达传统集群架构的2.5倍!在通讯密集型应用表现更为突出:处理阿里巴巴通义千问、深度求索等模型时,单卡速度飙升至600-750 token/秒。

突破性创新源自底层重构:

✓ 用高速总线替代传统以太网互联

✓ 通讯带宽提升15倍

✓ 单跳延迟从2微秒降至200纳秒(提升10倍)

【延伸思考】

1. 在半导体工艺受限情况下,架构创新能否持续弥补硬件代差?

2. 中美技术脱钩背景下,全球AI基础设施会形成怎样的新格局?

产业分析机构SemiAnalysis指出,CloudMatrix 384可能采用昇腾910C处理器:”华为芯片落后一代,但其扩展解决方案却领先英伟达和AMD当前产品一代。”这标志着华为的竞争策略已从硬件参数转向系统级优化。

目前,华为已在安徽、内蒙古、贵州等地数据中心部署该架构。系统支持数万级处理器互联,为训练更复杂AI模型提供强大平台。其出现既为行业提供了替代方案,也加速了全球技术基础设施的地缘分化。

专家指出,华为AI计算的长期成功取决于开发者生态建设和持续性能验证。对寻求供应链自主的企业而言,Supernode 384提供了兼具竞争力与独立性的新选择,但其发展仍受制于创新周期和地缘政治环境。

(配图来自Pixabay)

【相关阅读】

– 甲骨文拟斥资400亿美元采购英伟达芯片建设德州AI设施

– 关注阿姆斯特丹/加州/伦敦举办的AI与大数据博览会,同期还有智能自动化大会、区块链峰会等重磅活动

*本文由TechForge提供的企业技术活动资讯支持*

阅读AI News的原文,点击链接。